deepseek 上周发布了deepseek-v2模型,将现在优秀 llm 的价格战又抬上了一个新的高度,百万 token 输出只需要 2 元人民币。开放平台送的十块钱总共有 500 万 token 。冲个五十块钱估计够我用好几年。

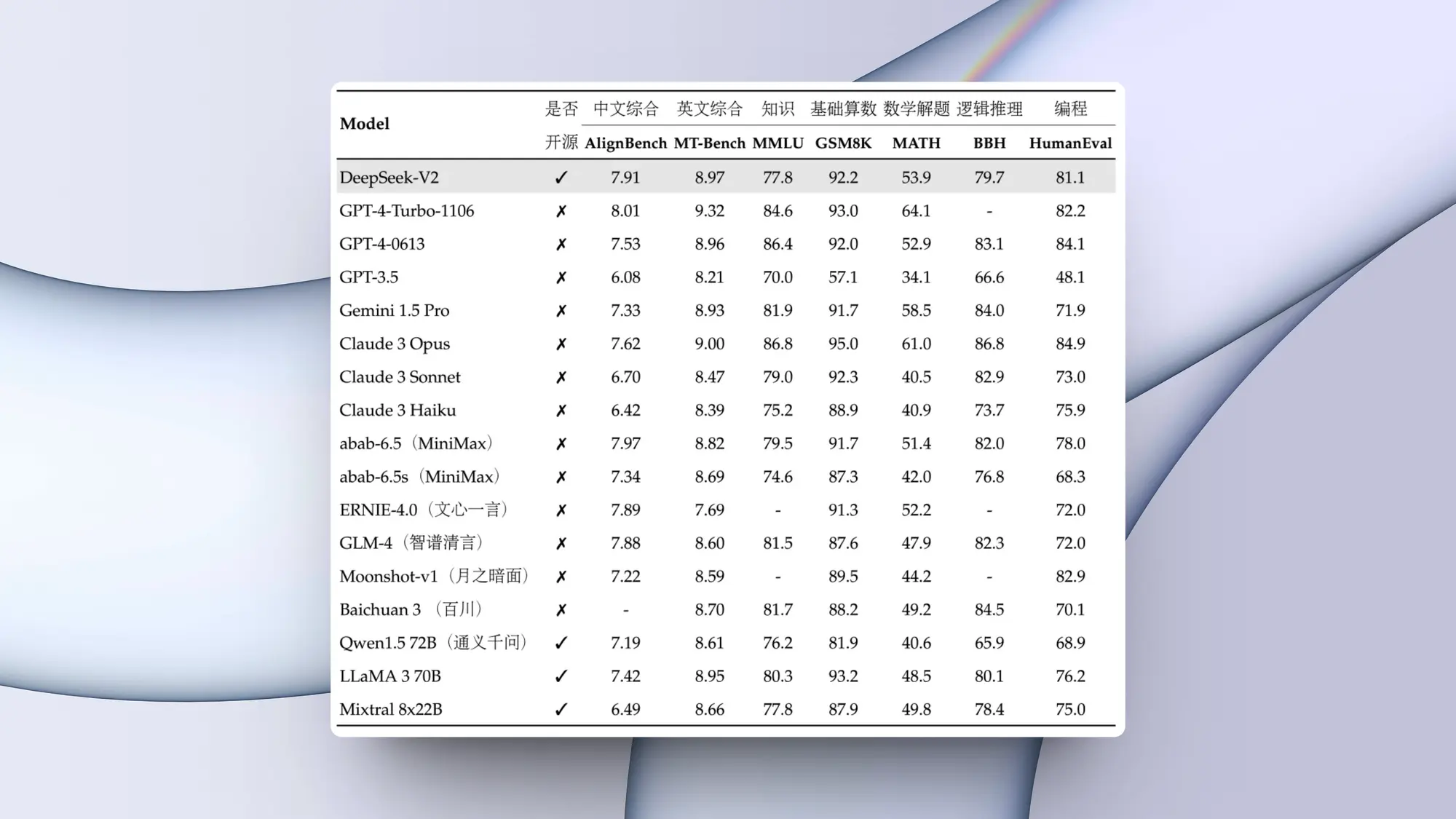

模型测评结果为:

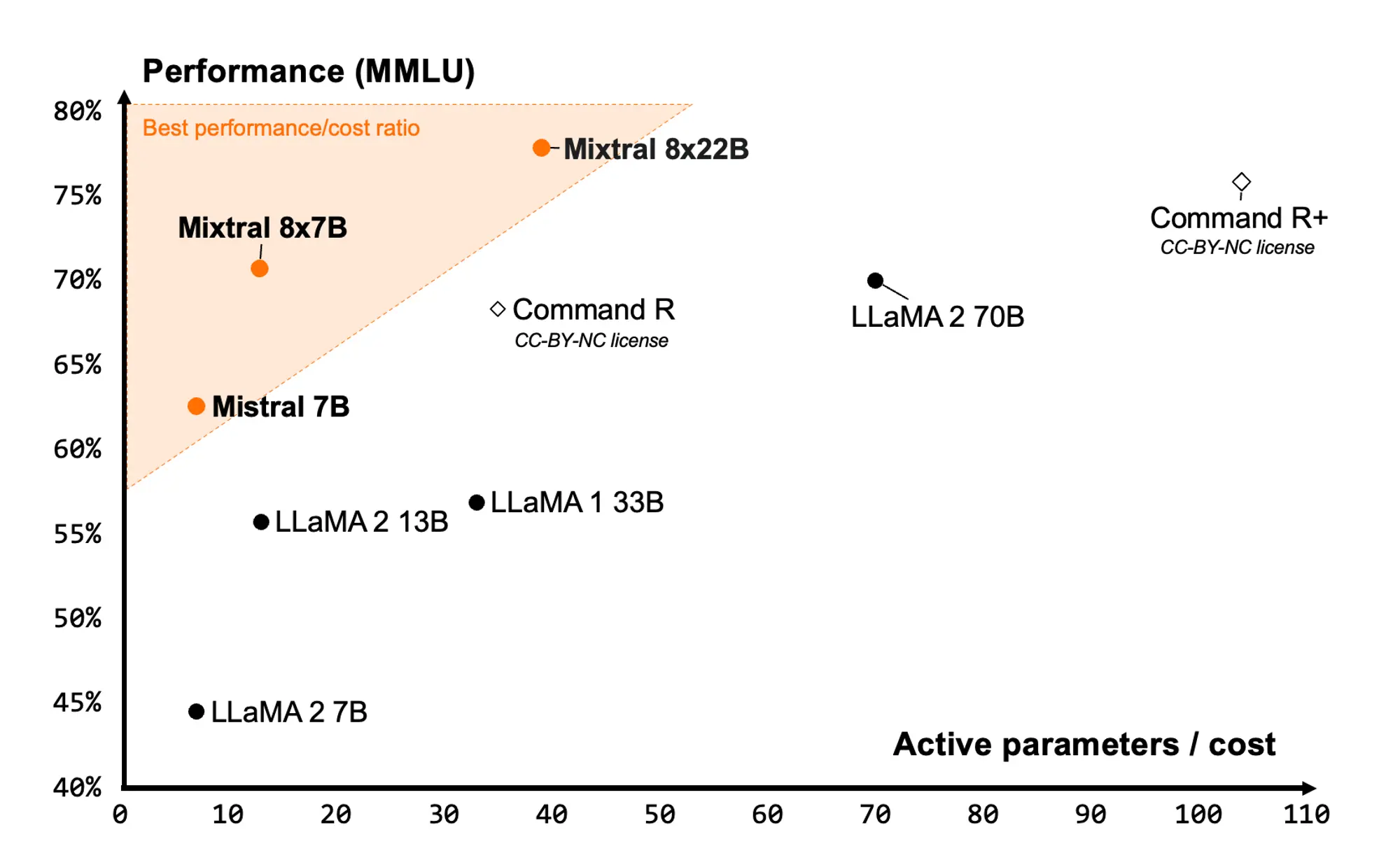

- 中文综合能力(alignbench)开源模型中最强,与gpt-4-turbo,文心4.0等闭源模型在评测中处于同一

- 英文综合能力(mt-bench)与最强的开源模型llama3-70b同处第一梯队,超过最强moe开源模型mixtral 8x22b

- 知识、数学、推理、编程等榜单结果也位居前列

- 支持128k上下文窗口

deepseek-v2以236b总参数、21b激活,大致达到70b~110b dense的模型能力,同时消耗的显存(kv cache)只有同级别dense模型的1/5~1/100,每token成本大幅降低。实际部署在8卡h800机器上,输入吞吐量超过每秒10万tokens,输出超过每秒5万tokens。

模型权重:https://huggingface.co/deepseek-ai

技术报告:https://github.com/deepseek-ai/deepseek-v2/blob/main/deepseek-v2-tech-report.pdf

体验模型:

原创文章,作者:校长,如若转载,请注明出处:https://www.yundongfang.com/yun296153.html

微信扫一扫不于多少!

微信扫一扫不于多少!  支付宝扫一扫礼轻情意重

支付宝扫一扫礼轻情意重