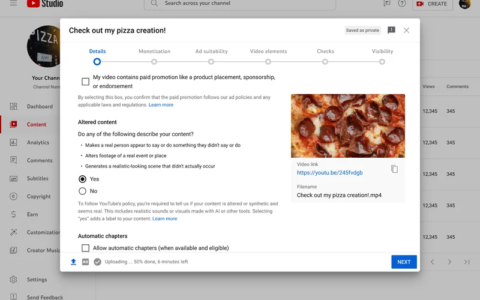

adobe 的人们开发了一种生成式 ai 模型,该模型很快就会让您将视频升级到原始的八倍。adobe在最近发表的一篇名为videogigagan的论文中声称,该模型远远优于过去的传统视频超分辨率(vsr)方法,这些方法往往会在升级尝试中引入ai伪影和大量模糊。

由于其生成式 ai 的优点,adobe 的 videogigagan “在保持时间一致性的同时,对具有高频细节的视频进行”。最终,新方法产生的结果具有更细粒度的细节,这意味着视频的保真度要高得多,并且包含的伪影要少得多。

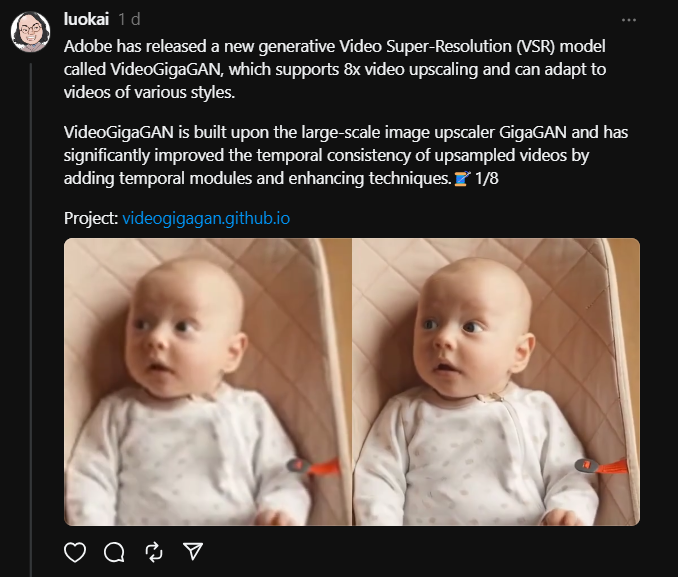

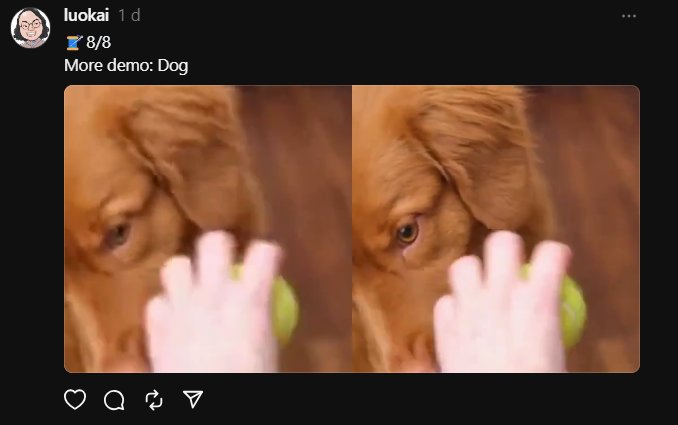

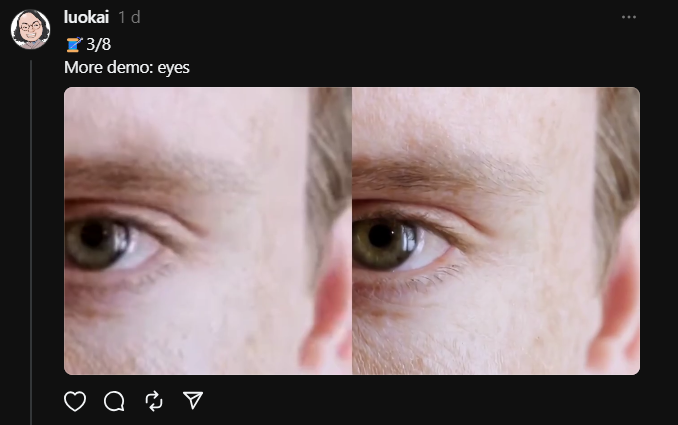

但不要相信我们的话。下面是一些示例,显示了 adobe 的新 vsr 方法的功能:

尽管过去的 vsr 方法已被证明在改善图像方面很有用,但它们的成功并没有以同样的方式转化为视频。虽然其他升级方法试图减少上采样引起的闪烁和其他 ai 怪异现象,但它们只是通过牺牲细节来做到这一点。

这就是生成对抗网络 (gan) 真正闪耀的地方。videogigagan不仅可以有效地消除视频失真(或减少它们,直到它们几乎不可见),还可以生成高质量的视频,可以放大到原始分辨率的8倍。

您可以在 videogigagan github 网站上找到更多上采样的前后比较。

adobe 去年的 max 活动也让我们看到了一个类似的项目,该项目使用基于扩散的 ai 上采样技术提高视频和 gif 的质量。然而,videogigagan 完全是一头不同的野兽。

由于 videogigagan 仍在开发中,示例只是预览,因此不知道 adobe 是否会将其提供给普通用户。尽管如此,如果样品是可以参考的,那么该技术足以推向市场,并且将来可以通过adobe的premiere pro提供。我们迫不及待地想亲自尝试一下,并为所有可能对提高模糊视频质量感兴趣的人进行审查。

原创文章,作者:校长,如若转载,请注明出处:https://www.yundongfang.com/yun294827.html

微信扫一扫不于多少!

微信扫一扫不于多少!  支付宝扫一扫礼轻情意重

支付宝扫一扫礼轻情意重